Uovervåget læring - Unsupervised learning

| Del af en serie om |

|

Maskinlæring og data mining |

|---|

|

Uovervåget indlæring er en form for maskinlæring , hvor algoritmen ikke er forsynet med foruddefinerede etiketter eller scoringer for træningsdataene. Som et resultat heraf skal uovervågede læringsalgoritmer først selv opdage eventuelle naturligt forekommende mønstre i dette træningsdatasæt. Almindelige eksempler omfatter clustering , hvor algoritmen automatisk grupperer sine træningseksempler i kategorier med lignende funktioner og hovedkomponentanalyse , hvor algoritmen finder måder at komprimere træningsdatasættet ved at identificere, hvilke funktioner der er mest nyttige til at skelne mellem forskellige træningseksempler, og kasserer resten. Dette står i kontrast til overvåget læring , hvor træningsdataene indeholder forudinddelte kategorimærker (ofte af et menneske eller fra output fra ikke-lærende klassifikationsalgoritme). Andre mellemniveauer i supervisionsspektret inkluderer forstærkningslæring , hvor der kun er numeriske scoringer tilgængelige for hvert træningseksempel i stedet for detaljerede tags, og semi-superviseret læring, hvor kun en del af træningsdataene er blevet mærket.

Fordelene ved uovervåget læring omfatter en minimal arbejdsbyrde for at forberede og revidere træningssættet, i modsætning til overvåget læringsteknik, hvor der kræves en betydelig mængde ekspert menneskeligt arbejde for at tildele og verificere de oprindelige tags, og større frihed til at identificere og udnytte tidligere uopdagede mønstre det er måske ikke blevet bemærket af "eksperterne". Dette kommer ofte på bekostning af ikke -overvågede teknikker, der kræver en større mængde træningsdata og konvergerer langsommere til acceptabel ydeevne, øgede beregnings- og opbevaringskrav under den undersøgende proces og potentielt større modtagelighed for artefakter eller anomalier i træningsdata, der muligvis er åbenlyse irrelevant eller anerkendt som fejlagtig af et menneske, men tillægges unødig betydning af den uovervåget læringsalgoritme.

Tilgange

Almindelige familier af algoritmer, der bruges i uovervåget indlæring, omfatter: (1) klynger, (2) anomaliedetektering, (3) neurale netværk (bemærk, at ikke alle neurale netværk er uden opsyn; de kan trænes af overvåget, uden opsyn, semi-overvåget eller forstærkningsmetoder) og (4) latente variable modeller.

- Klyngemetoder inkluderer hierarkisk klynge , k-midler , blandingsmodeller , DBSCAN og OPTICS-algoritme

- Anomalisøgning metoder omfatter Lokal Outlier Factor , og Isolation Skov

- Tilgange til indlæring af latente variabelmodeller inkluderer algoritme til forventning-maksimalisering , momentmetoden og teknikker til adskillelse af blinde signaler ( hovedkomponentanalyse , uafhængig komponentanalyse , ikke-negativ matrixfaktorisering , ental værdi-dekomponering )

- Neurale netværksmetoder inkluderer autoencodere , deep faith- netværk , hebbisk læring , generative adversarial netværk (GAN'er) og selvorganiserende kort

Metoder til øjeblikke

En statistisk tilgang til læring uden opsyn er metoden til øjeblikke . I metoden til øjeblikke er de ukendte parametre af interesse i modellen relateret til øjeblikke i en eller flere tilfældige variabler. Disse øjeblikke estimeres empirisk ud fra de tilgængelige dataprøver og bruges til at beregne de mest sandsynlige værdifordelinger for hver parameter. Momentmetoden viser sig at være effektiv til at lære parametrene for latente variabelmodeller , hvor der ud over de observerede variabler, der er tilgængelige i trænings- og inputdatasættene, også antages at eksistere en række ikke -observerede latente variabler og til at bestemme kategoriseringen af hver den samme. Et praktisk eksempel på latente variabelmodeller inden for maskinlæring er emnemodellering , som er en statistisk model til forudsigelse af ordene (observerede variabler) i et dokument baseret på dokumentets emne (latent variabel). Momentmetoden (tensor -dekomponeringsteknikker) har vist sig at konsekvent gendanne parametrene for en stor klasse latente variable modeller under visse forudsætninger.

Den forventning-maksimering algoritme er en anden praktisk metode til at lære latente variable modeller. Det kan dog sidde fast i lokal optima, og det garanteres ikke at konvergere til de sande ukendte parametre i modellen. I modsætning hertil er global konvergens garanteret under visse betingelser ved hjælp af momentmetoden.

Neurale netværk

De næste fem underafsnit indeholder grundmateriale. Flere materialer på mellemliggende niveau følger det i sammenligning af netværk og specifikke netværk. Avanceret materiale har deres egne Wikipedia -poster.

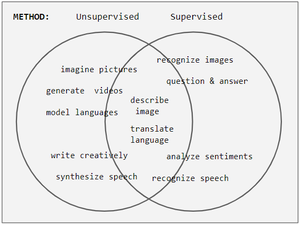

Opgaver vs. metoder

Traditionelt bruges overvågede metoder til genkendelsesopgaver, og metoder uden overvågning bruges til generative opgaver. Efterhånden som fremskridt marcherer videre, anvender nogle opgaver begge metoder, og nogle opgaver svinger fra en metode til en anden. For eksempel startede billedgenkendelse som stærkt overvåget, men blev hybrid ved at anvende uovervåget foruddannelse og gik derefter mod overvågning igen med fremkomsten af frafald, relu og adaptive læringshastigheder.

Uddannelse

Under indlæringsfasen forsøger et netværk uden opsyn at efterligne de data, det har givet, og bruger fejlen i sit efterlignede output til at rette sig selv (dvs. korrigere dets vægte og forspændinger). Dette ligner børns mimikadfærd, når de lærer et sprog. Nogle gange udtrykkes fejlen som en lav sandsynlighed for, at den fejlagtige output forekommer, eller den kan udtrykkes som en ustabil højenergitilstand i netværket.

I modsætning til den overvågede metodes dominerende brug af Backpropagation anvender ikke -overvågede metoder forskellige læringsalgoritmer, herunder: Hopfield -læringsregel, Boltzmann -læringsregel, Kontrastiv divergens, Wake Sleep, Variational Inference, Maximum A Posteriori, Gibbs Sampling, backpropagering af rekonstruktionsfejlen eller backpropagering af skjulte tilstandsreparametre. Se tabellen herunder for flere detaljer.

Energi

I Boltzmann -maskiner spiller energi rollen som omkostningsfunktionen. En energifunktion er et makroskopisk mål for et netværks tilstand. Denne analogi med fysik er inspireret af Ludwig Boltzmanns analyse af en gas makroskopisk energi fra de mikroskopiske sandsynligheder for partikelbevægelse p e E/kT , hvor k er Boltzmann -konstanten og T er temperaturen. I RBM -netværket er forholdet p = e −E / Z, hvor p & E varierer over alle mulige aktiveringsmønstre og Z = e -E (mønster) . For at være mere præcis, p (a) = e -E (a) / Z, hvor a er et aktiveringsmønster for alle neuroner (synlige og skjulte). Derfor bærer tidlige neurale netværk navnet Boltzmann Machine. Paul Smolensky kalder -E Harmonien. Et netværk søger lav energi, hvilket er høj harmoni.

Netværk

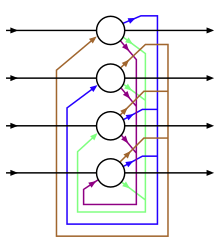

Denne tabel viser forbindelsesdiagrammer for forskellige netværk uden opsyn, hvis detaljer vil blive givet i afsnittet Sammenligning af netværk. Af de netværk, der bærer folks navne, arbejdede kun Hopfield direkte med neurale netværk. Boltzmann og Helmholtz levede før opfindelsen af kunstige neurale netværk, men de inspirerede til de anvendte analysemetoder.

| Hopfield | Boltzmann | RBM | Helmholtz | Autoencoder | VAE |

|---|---|---|---|---|---|

Historie

| 1969 | Perceptrons af Minsky & Papert viser, at en perceptron uden skjulte lag fejler på XOR |

| 1970'erne | (omtrentlige datoer) AI vinter I |

| 1974 | Ising magnetisk model foreslået af WA Little til erkendelse |

| 1980 | Fukushima introducerer neocognitron, som senere kaldes et konvolut neuralt netværk. Det bruges mest i SL, men fortjener at blive nævnt her. |

| 1982 | Ising variant Hopfield net beskrevet som CAM'er og klassifikatorer af John Hopfield. |

| 1983 | Ising variant Boltzmann -maskine med sandsynlige neuroner beskrevet af Hinton & Sejnowski efter Sherington & Kirkpatricks arbejde fra 1975. |

| 1986 | Paul Smolensky udgiver Harmony Theory, som er en RBM med praktisk talt samme Boltzmann energifunktion. Smolensky gav ikke en praktisk uddannelse. Hinton gjorde i midten af 2000'erne |

| 1995 | Schmidthuber introducerer LSTM -neuronen til sprog. |

| 1995 | Dayan & Hinton introducerer Helmholtz -maskine |

| 1995-2005 | (omtrentlige datoer) AI vinter II |

| 2013 | Kingma, Rezende og co. introducerede Variational Autoencoders som Bayesiansk grafisk sandsynlighedsnetværk, med neurale net som komponenter. |

Specifikke netværk

Her fremhæver vi nogle karakteristika ved hvert netværk. Ferromagnetisme inspirerede Hopfield -netværk, Boltzmann -maskiner og RBM'er. En neuron svarer til et jerndomæne med binære magnetiske øjeblikke op og ned, og neurale forbindelser svarer til domænet indflydelse på hinanden. Symmetriske forbindelser muliggør en global energiformulering. Under slutning opdaterer netværket hver tilstand ved hjælp af standardaktiveringstrinfunktionen. Symmetriske vægte garanterer konvergens til et stabilt aktiveringsmønster.

- Hopfield

- netværk bruges som CAM'er og vil med garanti gå til et vist mønster. Uden symmetriske vægte er netværket meget svært at analysere. Med den rigtige energifunktion vil et netværk konvergere.

- Boltzmann maskiner

- Disse er stokastiske Hopfield -net. Deres tilstandsværdi udtages fra denne pdf som følger: Antag, at en binær neuron affyrer med Bernoulli -sandsynligheden p (1) = 1/3 og hviler med p (0) = 2/3. Man prøver fra det ved at tage et UNIFORMLY fordelt tilfældigt tal y og tilslutte det til den inverterede kumulative fordelingsfunktion, som i dette tilfælde er trinfunktionen tærsklet til 2/3. Den omvendte funktion = {0 hvis x <= 2/3, 1 hvis x> 2/3}

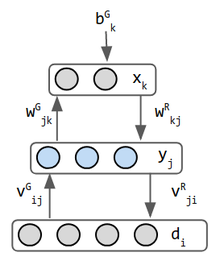

- Helmholtz

- Disse er tidlige inspirationskilder til Variational Auto Encoders. Det er 2 netværk kombineret til et - fremadvægte fungerer genkendelse og bagudvægte implementerer fantasi. Det er måske det første netværk, der gør begge dele. Helmholtz arbejdede ikke inden for maskinlæring, men han inspirerede synet til "statistisk inferensmotor, hvis funktion er at udlede sandsynlige årsager til sensorisk input" (3). den stokastiske binære neuron udsender en sandsynlighed for, at dets tilstand er 0 eller 1. Datainput er normalt ikke betragtet som et lag, men i Helmholtz maskingenereringstilstand modtager datalaget input fra mellemlaget har separate vægte til dette formål, så det betragtes som et lag. Derfor har dette netværk 3 lag.

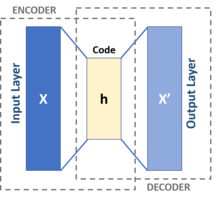

- Variational Autoencoder

- Disse er inspireret af Helmholtz -maskiner og kombinerer sandsynlighedsnetværk med neurale netværk. En Autoencoder er et 3-lags CAM-netværk, hvor det midterste lag formodes at være en vis intern repræsentation af inputmønstre. Encoderens neurale netværk er en sandsynlighedsfordeling q φ (z givet x), og dekodernetværket er p θ (x givet z). Vægtene hedder phi & theta frem for W og V som i Helmholtz - en kosmetisk forskel. Disse 2 netværk her kan være fuldt tilsluttet, eller bruge en anden NN -ordning.

Sammenligning af netværk

| Hopfield | Boltzmann | RBM | Helmholtz | Autoencoder | VAE | |

|---|---|---|---|---|---|---|

| brug og bemærkelsesværdige | CAM, rejsende sælger problem | CAM. Forbindelsesfriheden gør dette netværk svært at analysere. | mønstergenkendelse (MNIST, talegenkendelse) | fantasi, efterligning | sprog: kreativ skrivning, oversættelse. Vision: forbedring af slørede billeder | generere realistiske data |

| neuron | deterministisk binær tilstand. Aktivering = {0 (eller -1) hvis x er negativ, 1 ellers} | stokastisk binær Hopfield neuron | stokastisk binær. Udvidet til virkelig værdi i midten af 2000'erne | stokastisk, binær, sigmoid | sprog: LSTM. vision: lokale modtagelige felter. normalt reel værdsat reluaktivering. | mellemlagsneuroner koder midler og variationer for gaussere. I driftstilstand (inferens) samples output fra det midterste lag fra værdier fra gausserne. |

| forbindelser | 1-lags med symmetriske vægte. Ingen selvforbindelser. | 2-lag. 1-skjult og 1-synlig. symmetriske vægte. | <- samme. ingen laterale forbindelser i et lag. |

3-lags: asymmetriske vægte. 2 netværk kombineret til 1. | 3-lag. Input betragtes som et lag, selvom det ikke har nogen indgående vægte. tilbagevendende lag til NLP. feedforward -konvolutter for syn. input & output har de samme neurontællinger. | 3-lags: input, encoder, distribution sampler decoder. prøvetageren betragtes ikke som et lag (e) |

| slutning og energi | energi er givet ved Gibbs sandsynlighedsmåling: | ← samme | ← samme | minimere KL -divergens | slutning er kun feed-forward. tidligere UL -netværk løb frem og tilbage | minimer fejl = rekonstruktionsfejl - KLD |

| uddannelse | Δw ij = s i *s j , for +1/-1 neuron | Δw ij = e*(p ij - p ' ij ). Dette stammer fra minimering af KLD. e = læringshastighed, p '= forudsagt og p = faktisk fordeling. | kontrastiv divergens m/ Gibbs -prøveudtagning | wake-sleep 2-faset træning | tilbage udbred rekonstruktionsfejlen | reparameterize skjult tilstand for backprop |

| styrke | ligner fysiske systemer, så det arver deres ligninger | <--- samme. skjulte neuroner fungerer som en intern repræsentation af den ydre verden | hurtigere mere praktisk uddannelse end Boltzmann -maskiner | mildt anatomisk. analyserbar med informationsteori og statistisk mekanik | ||

| svaghed | svært at træne på grund af laterale forbindelser |

Hebbisk læring, KUNST, SOM

Det klassiske eksempel på læring uden opsyn i undersøgelsen af neurale netværk er Donald Hebbs princip, det vil sige neuroner, der brænder sammen, kører sammen. I hebbisk læring forstærkes forbindelsen uanset en fejl, men er udelukkende en funktion af sammenfaldet mellem handlingspotentialer mellem de to neuroner. En lignende version, der ændrer synaptiske vægte, tager hensyn til tiden mellem handlingspotentialerne ( spike-timing-afhængig plasticitet eller STDP). Hebbisk læring har været en hypotese om at ligge til grund for en række kognitive funktioner, såsom mønstergenkendelse og erfaringslæring.

Blandt neurale netværksmodeller bruges det selvorganiserende kort (SOM) og adaptiv resonansteori (ART) almindeligt i uovervåget læringsalgoritme. SOM er en topografisk organisation, hvor steder i nærheden på kortet repræsenterer input med lignende egenskaber. ART-modellen tillader antallet af klynger at variere med problemstørrelse og lader brugeren kontrollere graden af lighed mellem medlemmer af de samme klynger ved hjælp af en brugerdefineret konstant kaldet årvågenhedparameteren. ART -netværk bruges til mange mønstergenkendelsesopgaver, såsom automatisk målgenkendelse og seismisk signalbehandling.

Se også

- Automatiseret maskinlæring

- Klynge analyse

- Anomali detektion

- Forventning -maksimeringsalgoritme

- Generativt topografisk kort

- Metalæring (datalogi)

- Multivariat analyse

- Radialbaseret funktionsnetværk

- Svagt tilsyn

Referencer

Yderligere læsning

- Bousquet, O .; von Luxburg, U .; Raetsch, G., red. (2004). Avancerede forelæsninger om maskinlæring . Springer-Verlag. ISBN 978-3540231226.

- Duda, Richard O .; Hart, Peter E .; Stork, David G. (2001). "Uovervåget læring og klynger". Mønsterklassificering (2. udgave). Wiley. ISBN 0-471-05669-3.

- Hastie, Trevor; Tibshirani, Robert (2009). Elementerne i statistisk læring: Data mining, slutning og forudsigelse . New York: Springer. s. 485–586. doi : 10.1007/978-0-387-84858-7_14 . ISBN 978-0-387-84857-0.

- Hinton, Geoffrey ; Sejnowski, Terrence J. , red. (1999). Unsupervised Learning: Foundations of Neural Computation . MIT Tryk . ISBN 0-262-58168-X.(Denne bog fokuserer på uovervåget læring i neurale netværk )